Sommaire

« L’IA, partout. Alors, parlons-en bien. » C’est notamment cette phrase, lue sur le site de l’association Latitudes, association qui défend depuis sa création en 2017 une technologie engagée et responsable, qui nous a donné envie d’échanger avec ses membres autour de l'IA et de son impact environnemental et sociétal. En 2024, 21 500 personnes ont participé aux actions de l'asso et 550 bénévoles se sont mobilisés à leurs côtés partout en France. Entretien avec Margaux Levisalles, cofondatrice de Latitudes.

Bonjour Margaux. Peux-tu commencer par nous présenter la mission de Latitudes et ses différentes actions ?

Margaux Levisalles : Latitudes est une association qui existe depuis huit ans ; nous avons fêté ce huitième anniversaire au mois de mai. Notre métier, c’est de créer et de déployer des programmes d’enseignement à la citoyenneté numérique, que l’on appelle aussi le numérique engagé et responsable. La thématique que nous cherchons à traiter, c’est le développement d’un regard et d’une action critique sur les questions éthiques, sociales et environnementales des technologies numériques. Il y a deux volets principaux auxquels nous nous intéressons. Le premier est celui de la finalité du numérique : s’assurer que les outils numériques proposés sont conçus pour répondre aux enjeux de la transition écologique et solidaire. Le deuxième volet concerne les moyens de développement du numérique. Est-il conçu de manière démocratique ? Quelle est son empreinte environnementale ? Quels sont ses impacts sociétaux ?

« L’objectif, c’est de former des concepteurs qui, demain, auront déjà un regard aiguisé sur ces enjeux. »

À qui sont destinés vos contenus et programmes ?

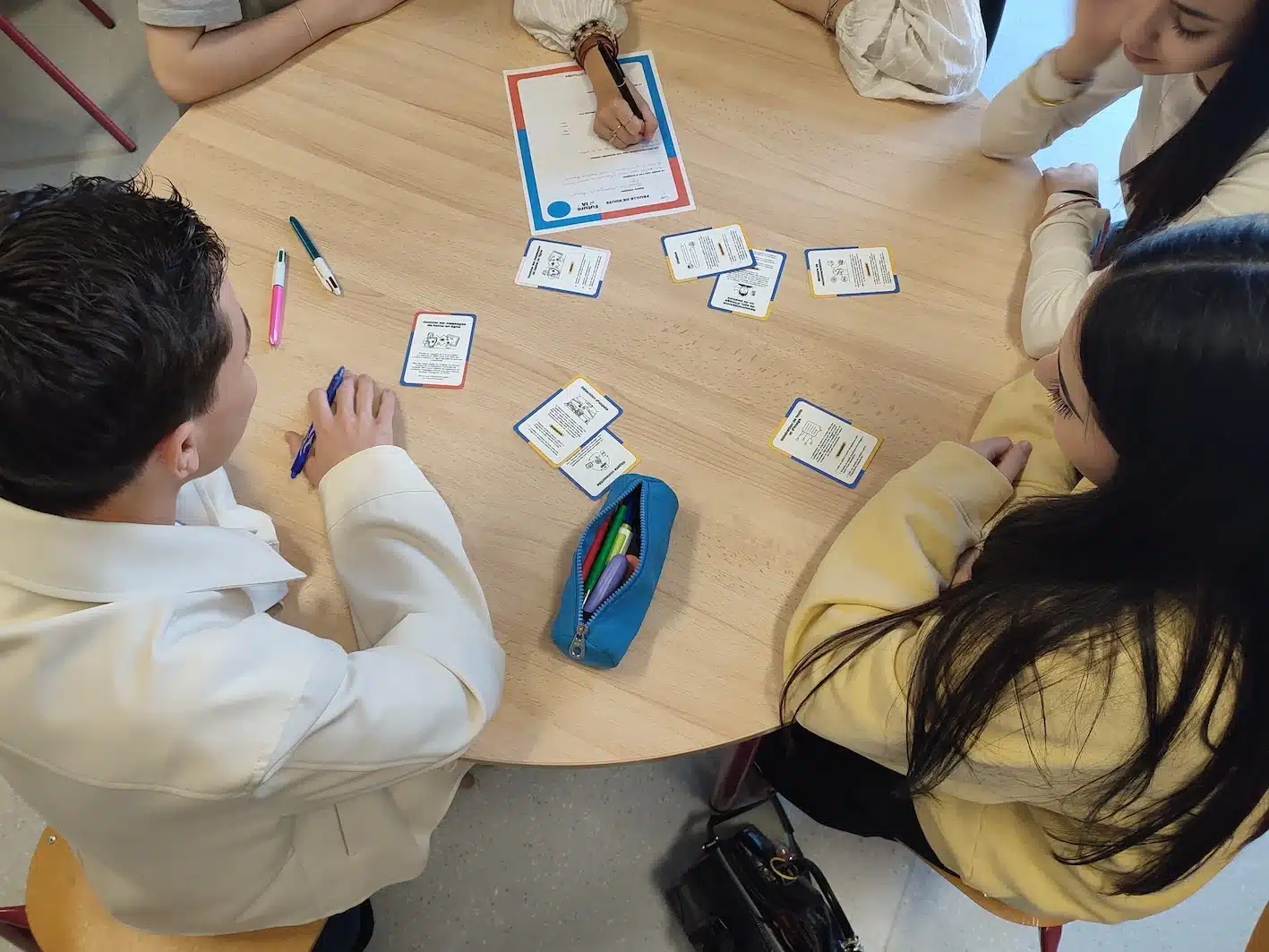

M. L. : Aujourd’hui, nous créons des communs pédagogiques, puis nous formons à l’utilisation de nos différents outils soit des bénévoles, soit des enseignantes et enseignants dans les milieux scolaires et universitaires, soit des salariés et agents dans le monde de l'entreprise. Ensuite, nous déployons nos programmes auprès de ces acteurs. Nous intervenons à partir du collège jusqu’au monde professionnel, et même au-delà, puisque nous nous adressons aussi aux citoyens et citoyennes. Nous proposons des contenus de sensibilisation, notamment à travers des jeux de cartes, par exemple La Bataille de l’IA. Il s’agit d’un jeu de cartes d’une durée de deux heures, qui vise à exercer l’esprit critique sur notre rapport aux IA et à l’IA générative. Nous avons également des outils favorisant le passage à l’action, pour mettre les mains dans le cambouis et imaginer un autre numérique. Ils s’adressent plutôt à des acteurs en formation dans le domaine du numérique ou à des personnes qui y travaillent déjà. Nous nous adressons à ces deux cibles : à la fois les concepteurs et les utilisateurs. L’objectif, c’est aussi de former des concepteurs qui, demain, auront déjà un regard aiguisé sur ces enjeux.

Quel est le positionnement de Latitudes vis-à-vis de l’IA ? Quel est votre principal combat ?

M. L. : Étonnamment, nous n’avons pas encore rédigé de Manifeste d’utilisation en interne. Par essence, dans notre métier d’éducation et de sensibilisation, le premier enjeu va être de comprendre si on a besoin de l’IA, ce que ça signifie, quels sont les impacts derrière… L’enjeu principal c’est surtout d’en avoir un usage raisonné. Il y a un développement assez effréné de ces technologies, et on essaie de pouvoir apporter un regard plus éthique sur ces usages dès le plus jeune âge. Dans les collèges et les lycées, on a beaucoup d’enseignantes et enseignants qui nous ont demandé assez rapidement de déployer des outils dessus. On a lancé l’an passé un dispositif pour les lycéens, Future of IA, qui permet de faire découvrir à la fois les métiers et les impacts de l’IA.

Au-delà de questionner sur la nécessité d’utiliser des IAs et de comprendre leurs impacts, il est aussi important de bien comprendre ce dont on parle. C’est pourquoi nous avons des programmes qui traitent d’Intelligence Artificielle et d’autres de l’IA génératives. On essaie de démystifier ces thématiques. Il y a d’autres acteurs complémentaires qui travaillent sur la manière dont fonctionne une IA, par exemple La Boîte Noire de l’IA, créée il y a peu par Data Activist. Enfin, dans l’un de nos ateliers à venir pour le milieu associatif, par exemple, on va venir expliciter les questions à se poser pour avoir un cadre d’utilisation qui correspond à son éthique.

« Aujourd’hui, à travers le prisme de l'IA, notamment générative, on arrive à aborder à nouveau la question du regard critique sur les technologies numériques. »

Peux-tu nous donner un exemple d'une de ces questions ?

M. L. : La question vraiment prioritaire est : est-ce qu’on a besoin d’IA dans nos usages ? Aujourd’hui, on a encore très peu d’exemples de cas où c’est réellement pertinent et nécessaire. En ce moment, on est en train de réfléchir à un format qui permettrait de définir en interne quelle est sa charte d’usage. On ne l’a pas encore mis sur pied, mais suite à La Bataille de l’IA, on entend qu’il y a un vrai besoin. L’Institut du Numérique Responsable a créé un document de bonnes pratiques sur l’IA, le référentiel IA Éthique et Responsable, sur lequel il y a déjà un certain nombre de recommandations. Dans La Bataille de l’IA, on en aborde aussi certaines, comme questionner la valeur qu’apportent les services d’IA par rapport à leurs impacts, adapter le niveau de performance (la qualité, la rapidité de réponse) à son besoin, mesurer l'impact environnemental avant, après et pendant les usages, bien comprendre comment le modèle est construit… J’ai l’impression aussi que chaque acteur va avoir sa propre vision et faire ses propres choix sur ce qu’est un usage éthique à ses yeux. Notre enjeu premier est surtout d’informer, de faire comprendre les impacts et de développer un regard critique pour, derrière, pouvoir décider soi-même de ses usages en comprenant toutes les mécaniques qui sont à l'œuvre. Que ça n’est pas magique, qu’on n’en a pas absolument besoin… Des thématiques qui, finalement, se rapprochent des questions déjà présentes autour du numérique en général. L’IA générative les a remis sur le devant de la scène et a exacerbé certaines problématiques, mais finalement ça n'est pas nouveau. Aujourd’hui, à travers le prisme de l'IA, notamment générative, on arrive à aborder à nouveau la question du regard critique sur les technologies numériques.

Pour vous, chez Latitudes, de quoi doit-on nécessairement parler quand on évoque l’IA ?

M. L. : Premièrement, il existe plein de types d’IA, entre ce qui va être de l’IA prédictive, des IA génératives… Et il y a plusieurs modèles différents avec des garde-fous plus ou moins établis. Aujourd’hui, quand on parle d’IA, les gens se réfèrent souvent aux IA génératives, parce que ce sont celles qui sont le plus appréhendables par le commun des mortels, mais c'est important de comprendre le contexte plus général dans lequel cela s’inscrit.

Deuxième, il est essentiel, bien sûr, de parler des différents impacts liés aux IA génératives. Pour réaliser La Bataille de l’IA, un format créé avec l'association Data For Good, qui a rédigé un livre blanc à l’été 2023 sur cette thématique, on a distingué cinq enjeux clés :

- l’impact environnemental, évidemment,

- les impacts sociétaux, notamment la question de l’enseignement de l’IA à l’école : est-ce qu’il faut l’intégrer aux programmes, et si oui, comment ? Mais aussi la question de l’impact sur les métiers de demain et l’évolution de certains métiers, l’influence que ça peut avoir sur les questions démocratiques,

- la question de la créativité, ce qui a attrait aux droits d'auteur et à la propriété intellectuelle, à qui appartient ce qu’on crée, qu’est-ce qu’on peut utiliser, comment on cite…

- la question de fiabilité : comment est-ce qu’on sait quand une IA « hallucine » et qu’elle invente des données, par exemple. Comment est-ce qu’on retrouve des sources fiables ?

- le sujet des biais dans les différents jeux de données et l’impact que ça a sur la société qu’on est en train de créer.

En quoi consiste vos formations auprès des plus jeunes ?

M. L. : Au cœur de la vision de Latitudes, il y a cette envie de réfléchir à une manière de réinventer l’enseignement au numérique, afin d’intégrer dès le plus jeune âge la question de ses impacts sociaux et sociétaux. Auprès de la jeunesse, on revient aux questions de base de l’éducation aux médias : croiser ses sources, avoir au moins deux sources en parallèle… Des choses qui se sont déjà perdues à l’aune de l’utilisation de tout un tas de moteurs de recherche et outils en ligne, avec des sources parfois assez douteuses. Avec l’explosion des IA génératives, c’est exacerbé, mais cet enjeu était déjà prégnant et existant. Sans pouvoir prédire le futur, ce qui est certain c’est que ces outils vont continuer à se développer, et qu’il est donc impossible d'ignorer ce sujet, de le mettre sous le tapis ou de l’interdire. Notre rôle, justement, c’est de dire que les jeunes s’emparent de ces sujets, qu’on va utiliser massivement ces outils, et qu’il faut arriver à leur faire comprendre que ces outils résultent de choix, et qu’ils ont leur voix à donner sur le sujet. On observe la même dynamique auprès des citoyens et citoyennes qui n’osent pas toujours s’exprimer sur le sujet, qui ont l’impression de ne pas être légitime. Typiquement, La Bataille de l’IA, on l’a fait auprès de tout type de public et le message est aussi de montrer que c’est un sujet éminemment politique sur lequel tout le monde peut avoir une voix. En tant que citoyens, vous avez le droit de vous exprimer dessus, c’est crucial, sinon ce sont des choix qui vont être faits pour vous. Il y a aussi une réalité : tout le monde ou presque utilise de l’IA, pas forcément générative, car il y en a dans énormément d'outils qu’on utilise au quotidien. Dans ces usages banalisés, il y a des choix qui sont fait pour nous, qu’il est crucial de cerner pour pouvoir se positionner.

L’IA peut-elle jouer un rôle dans la lutte contre le dérèglement climatique ?

M. L. : Je pense à un dispositif comme Climate Q&A, un assistant conversationnel, pour aider à mieux comprendre la question du changement climatique et ses impacts sur la biodiversité. C’est un outil qui a été développé, entre autres, par Théo Alves, de Data For Good. C’est un modèle d’IA générative qui se base uniquement sur les rapports publiés par le GIEC, qui permet de venir poser ses questions, d'obtenir des sources, des recommandations, et donc de mieux comprendre… Il y a tout un panel de questions plus ou moins complexes : pourquoi est-ce que ça génère la montée des océans ? Quelles sont les évidences qu’on a du réchauffement climatique ? Qu’est-ce qu'il faut faire dans tel ou tel cas ? C’est un exemple d’usage dans lequel la création d’un outil d'intelligence artificielle générative permet d'avoir une meilleure compréhension des enjeux écologiques. Cela aide les citoyens et citoyennes à décrypter les rapports du GIEC qui peuvent être complexes.

Ce que l’on observe, c’est qu’aujourd’hui on a encore peu d’exemples dans lesquels les IA génératives sont nécessaires. Le fait de faire une requête sur ChatGPT plutôt que d’utiliser un moteur de recherche n’a pas forcément d’énormes plus-values, pourtant les impacts environnementaux et la consommation énergétique induits par les usages sont eux bien réels. Il y a certainement des cas plus spécifiques au sein d’organisations et d'entreprises qui sont à prendre au cas par cas, mais on peut difficilement aujourd’hui en faire une généralité pour dire qu’il existe une IA parfaitement sobre et éthique. Par essence, le fait que tous les citoyens s’emparent d’un outil qu’on n’utilisait pas avant, c’est assez questionnable. On en revient à la question : est-ce que le progrès technique est toujours fondamentalement bon ? Personnellement, je ne pense pas. Je pense qu’il faut se poser la question de ce qu'est le progrès social, le progrès technique, et en quoi les deux se répondent. Sur l’IA, comme sur les questions du numérique, on ne peut pas faire cette affirmation de but en blanc.

Quelle est votre vision du futur de l’IA dans le cadre du travail et de la société ? De quoi rêvez-vous ?

M. L. : C’est une bonne question, que je ne me suis pas tellement posée sous cette forme honnêtement. Peut-être simplement que ce n’est pas d’IA du tout ! Plus sérieusement, je dirais que c’est déjà des outils qui prennent en compte les thématiques mises en lumière par La Bataille de l’IA : la question des impacts environnementaux, des effets sur la société, des biais dans les jeux de données utilisés, et de la fiabilité de l’information.

Je souhaite vivement que demain toutes les personnes qui utilisent ces outils aient à chaque fois un regard critique sur la nécessité et la pertinence de leur usage. Par ailleurs, j’aimerais que les personnes qui conçoivent ces outils soient formées à la question des impacts, notamment sur les utilisateurs finaux. Par exemple, tout le monde n’a pas la même lucidité entre des utilisateurs très informés et des utilisateurs pour qui l’outil leur tombe entre les mains. Pour cela, on peut mettre en place des choses simples, comme le fait que lorsqu'une IA générative est utilisée, cela soit stipulé de manière assez claire aux utilisateurs et utilisatrices, ce qui n’est pas forcément le cas aujourd’hui. L’article édité par Limites Numériques, sur le forcing de l’IA et la manière dont on nous force à l’utiliser aux regards des investissements qui ont pu être faits, est très intéressant. J’aimerais que ce genre de thématique soit considérée, mais je suis incapable aujourd’hui de dire comment ça va évoluer.

Tu restes optimiste malgré tout ?

M. L. : Je ne suis pas complètement pessimiste. La question des impacts sociaux et sociétaux du numérique intéressait quand même peu de monde, et aujourd’hui le fait qu’on mette des outils d'IA génératives, comme Copilot par exemple, dans les mains de collaborateurs, pose rapidement des questions éthiques, donc il y a aussi très vite des réflexions qui commencent à mûrir sur ces thématiques qui n'existaient pas du tout avant. Je me dis qu’il y a là-dedans une brèche dans laquelle s’engouffrer, ce sont des choses qui, pour le coup, me rendent assez optimistes. Il y a aussi une partie de la communauté enseignante qui réagit sur ces sujets.

Les présidentielles aux États-Unis ont également participé à ce regain. Elles ont remis sur le devant de la scène tous les enjeux de souveraineté qui n’étaient pas du tout des sujets clefs pour le grand public, et dont on ne comprend pas forcément toujours les tenants et aboutissants. Cela a remis un coup de projecteur sur ce sujet.

Cela amène aussi la question de la neutralité des IA…

M. L. : On parle d’IA, mais dans les enjeux du numérique, il y a déjà la question d’une technologie neutre. La technologie n'est jamais neutre, puisqu’on décide la manière dont on la conçoit. Quand on va demander une réponse à tel ou tel outil d'IA générative, on va avoir des regards qui sont assez différents et on comprend très bien qu’il y a eu des choix faits dans les données utilisées. Je recommande souvent l’outil très bien pensé, compar:IA, qui permet facilement avec certaines fonctionnalités de comprendre l’impact environnemental et la manière de choisir les IA génératives en fonction de la typologie de besoins qu’on peut avoir. L'outil permet aussi de mettre en avant les enjeux de fiabilité de l'information délivrée et du coup des choix faits par les concepteurs et conceptrices.

Pour terminer, c’est quoi être techno-lucides ?

M. L. : On est justement en train de rédiger notre manifeste sur ce sujet en interne, c’est drôle de se dire qu’au bout de huit ans on ne l’a toujours pas écrit. C’est certainement la preuve que le numérique demande a être pensé dans le temps long et non dans la frénésie qui l’entoure généralement.

Il y a un certain nombre de principes, notamment comprendre que la technologie n’est pas neutre, que ça n’est pas magique mais explicable etc. Pour Latitudes, c’est vraiment s’assurer de la finalité des outils numériques utilisés et, d’autre part, être en capacité de questionner les moyens par lesquels on développe et on utilise le numérique. Si on a un regard et une action critique sur tous ces questionnements posés par les technologies numériques autour de ces deux volets, on atteint déjà un certain niveau de techno-lucidité. Qui est d’ailleurs un joli terme largement utilisé par Data For Good. On parle aussi de techno-critique sur la même ligne, en opposition à une technophilie ou une technophobie très extrêmes.

Des ressources pour aller plus loin :

- Le site de Latitudes

- Le jeu de cartes collaboratif La Bataille de l'IA (prochaine session de découverte en ligne le 2 juillet)

- Le site de l'association Data For Good

- Le livre blanc Les grands défis de l'IA générative de Data For Good

- L'article de Limites Numériques Le forcing de l'IA